Definición corta

La entropía cruzada y la puntuación de Brier son funciones de pérdida utilizadas para evaluar modelos probabilísticos. Ambas comparan probabilidades predichas con resultados reales, pero difieren en cómo penalizan los errores.

Definición detallada

La Entropía cruzada y la Puntuación de Brier son dos métricas fundamentales para evaluar modelos que producen probabilidades, como clasificadores binarios o redes neuronales.

Entropía cruzada

La entropía cruzada mide la discrepancia entre la distribución real y la distribución predicha mediante una función logarítmica:

- Penaliza fuertemente las predicciones muy incorrectas y seguras

- Si el modelo asigna probabilidad cercana a 0 a la clase correcta → la pérdida crece rápidamente

- Es la función estándar en entrenamiento de redes neuronales

👉 Intuición: “Castiga mucho la confianza equivocada”

Puntuación de Brier

La puntuación de Brier mide el error cuadrático entre la probabilidad predicha y el resultado real:

- Penaliza los errores de forma suave y simétrica

- No explota como la entropía cruzada

- Es más interpretable como una media de errores

👉 Intuición: “Mide qué tan lejos estás, sin exagerar”

Diferencias clave

| Aspecto | Entropía cruzada | Puntuación de Brier |

|---|---|---|

| Tipo de función | Logarítmica | Cuadrática |

| Penalización de errores | Muy agresiva | Suave |

| Sensibilidad a confianza incorrecta | Alta | Moderada |

| Uso en entrenamiento | Muy común | Menos común |

| Interpretabilidad | Menor | Mayor |

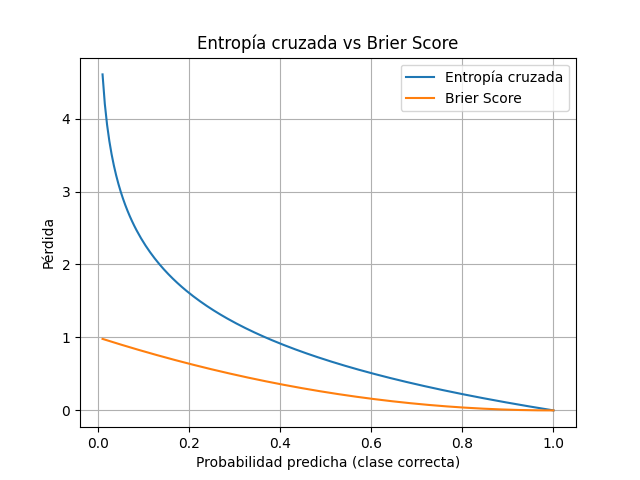

Intuición visual

- Entropía cruzada:

- Crece muy rápido cuando p → 0 (y la clase real es 1)

- Tiene forma asimétrica

- Brier Score:

- Curva parabólica

- Penaliza de forma gradual

¿Cuándo usar cada una?

Usa entropía cruzada cuando:

- Estás entrenando redes neuronales

- Quieres castigar predicciones muy equivocadas

- Te importa la optimización eficiente

Usa Brier Score cuando:

- Quieres evaluar calibración de probabilidades

- Buscas interpretabilidad

- Estás comparando modelos probabilísticos

💡 Insight clave

Un modelo puede tener buena precisión pero mala calibración.

- La entropía cruzada optimiza el aprendizaje

- La puntuación de Brier evalúa qué tan bien calibradas están las probabilidades

Ejemplo conceptual

Supongamos que la clase real es 1:

| Probabilidad predicha | Entropía cruzada | Brier Score |

|---|---|---|

| 0.9 | Baja | Baja |

| 0.5 | Media | Media |

| 0.1 | Muy alta | Alta |

👉 La entropía cruzada castiga mucho más el caso 0.1 que Brier.

Conceptos relacionados

- Entropía

- Función de pérdida

- Calibración de probabilidades

- Log-loss

- Evaluación de modelos

Ejemplo en Python

import numpy as npimport matplotlib.pyplot as pltp = np.linspace(0.01, 1, 200)# Entropía cruzada (y=1)cross_entropy = -np.log(p)# Brier Score (y=1)brier = (p - 1) ** 2plt.plot(p, cross_entropy, label="Entropía cruzada")plt.plot(p, brier, label="Brier Score")plt.xlabel("Probabilidad predicha (clase correcta)")plt.ylabel("Pérdida")plt.title("Entropía cruzada vs Brier Score")plt.legend()plt.grid(True)plt.show()

Conclusión

La diferencia fundamental es filosófica:

- Entropía cruzada: optimiza el aprendizaje penalizando fuertemente los errores graves

- Brier Score: mide la calidad probabilística de forma equilibrada

Ambas son herramientas esenciales, pero sirven propósitos distintos dentro del ciclo de vida de un modelo.

Ejemplo en Python

Este concepto incluye un ejemplo práctico en Python para ayudarte a entenderlo mejor: