Clasificación multiclase vs clasificación binaria/multilabel

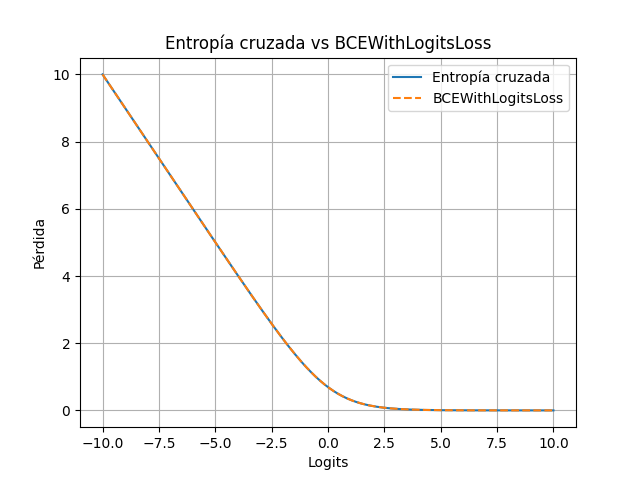

Entropía cruzada y BCEWithLogitsLoss son dos funciones de pérdida fundamentales en deep learning, pero se utilizan en problemas distintos.

👉 La diferencia principal depende de cómo están organizadas las clases:

- clases mutuamente excluyentes

- múltiples etiquetas independientes

Definición corta

- Entropía cruzada → clasificación multiclase

- BCEWithLogitsLoss → clasificación binaria o multilabel

🔹 Entropía cruzada

La entropía cruzada se utiliza cuando:

👉 solo una clase puede ser correcta.

📊 Ejemplo

Imagen → gato / perro / pájaro

👉 una única salida correcta.

🧠 Activación típica

Usa:

- Softmax implícito

📐 Fórmula

L=−∑iyilog(y^i)

👉 compara distribución real vs predicha.

📊 Ejemplo conceptual

Clases compiten entre sí

🔹 BCEWithLogitsLoss

Se utiliza cuando:

👉 cada clase es independiente.

📊 Ejemplo

Película → acción + aventura + ciencia ficción

👉 múltiples etiquetas posibles.

🧠 Activación típica

Usa:

- Sigmoid implícita por clase

📐 Fórmula

👉 aplicada individualmente a cada etiqueta.

🔄 Comparación directa

| Aspecto | Entropía cruzada | BCEWithLogitsLoss |

|---|---|---|

| Problema | multiclase | binario / multilabel |

| Activación | Softmax | Sigmoid |

| Clases | mutuamente excluyentes | independientes |

| Salida | una clase | múltiples etiquetas |

📊 Ejemplo conceptual

Softmax → competencia Sigmoid → independencia

🧠 Diferencia probabilística

🔹 Entropía cruzada

Las probabilidades cumplen:

👉 solo una clase domina.

🔹 BCEWithLogitsLoss

Cada clase tiene:P(yi=1)

👉 independientes entre sí.

📊 Ejemplo conceptual

Multiclase → una decisión Multilabel → varias decisiones

🧠 Diferencia en entradas esperadas

Ambas esperan:

- logits

⚠️ normalmente NO debes aplicar:

- Softmax manual

- Sigmoid manual

📊 Ejemplo conceptual

Logits ↓ Pérdida ✔ correcto

⚠️ Error extremadamente común

❌ usar Softmax en multilabel.

Etiquetas independientes ↓ Softmax ❌ incorrecto

👉 porque Softmax fuerza competencia entre clases.

🧠 Uso típico

🔹 Entropía cruzada

- clasificación de imágenes

- NLP multiclase

- reconocimiento de voz

🔹 BCEWithLogitsLoss

- multilabel

- detección de anomalías

- clasificación binaria

📊 Ejemplo conceptual

Tipo de problema ↓ Elegir pérdida adecuada

📊 Ejemplo en PyTorch

🔹 Entropía cruzada

import torch.nn as nnloss_fn = nn.CrossEntropyLoss()

🔹 BCEWithLogitsLoss

import torch.nn as nnloss_fn = nn.BCEWithLogitsLoss()

🧠 Qué muestran estos ejemplos

- diferencias estructurales

- distintas interpretaciones probabilísticas

- distintas arquitecturas

⚠️ Errores comunes

Confundir multiclase con multilabel

Problemas diferentes.

Aplicar activaciones manualmente

Puede romper entrenamiento.

Elegir pérdida incorrecta

Impacta totalmente el aprendizaje.

📊 Ejemplo conceptual en ML

Datos ↓ Tipo de etiquetas ↓ Función de pérdida correcta

🧠 Interpretación profunda

Esta comparación refleja un principio clave:

👉 La estructura probabilística del problema determina cómo debe aprender el modelo

Elegir correctamente entre:

- entropía cruzada

- BCEWithLogitsLoss

es esencial para construir clasificadores efectivos.

Conclusión

- Entropía cruzada → clasificación multiclase

- BCEWithLogitsLoss → clasificación binaria o multilabel

👉 Comprender esta diferencia es fundamental en deep learning moderno.

Related Concepts

- Softmax

- Sigmoid

- Clasificación multiclase

- Clasificación multilabel

- Logits