Definición breve

La convergencia es el proceso mediante el cual un modelo de aprendizaje automático se aproxima a una solución óptima durante el entrenamiento, reduciendo progresivamente la función de pérdida.

Definición detallada

En el entrenamiento de modelos, el objetivo es minimizar una función de pérdida (loss function) que mide el error entre las predicciones y los valores reales.

La convergencia ocurre cuando:

- La pérdida deja de disminuir significativamente

- Los parámetros del modelo se estabilizan

- El modelo alcanza un rendimiento cercano al óptimo

👉 En otras palabras, el modelo “ha aprendido lo suficiente” de los datos.

Cómo ocurre la convergencia

Durante el entrenamiento:

- El modelo realiza predicciones

- Calcula el error (loss)

- Ajusta sus parámetros mediante optimización

- Repite el proceso

👉 Con el tiempo, los cambios se vuelven más pequeños hasta estabilizarse.

Señales de convergencia

Un modelo ha convergido cuando:

- La pérdida se estabiliza

- Las mejoras son mínimas entre epochs

- Las métricas dejan de cambiar significativamente

Tipos de convergencia

🔹 Convergencia rápida

- El modelo aprende rápidamente

- Puede ser inestable si no se controla

Convergencia lenta

- Aprendizaje gradual

- Más estable, pero requiere más tiempo

No convergencia

- La pérdida no se estabiliza

- El modelo oscila o diverge

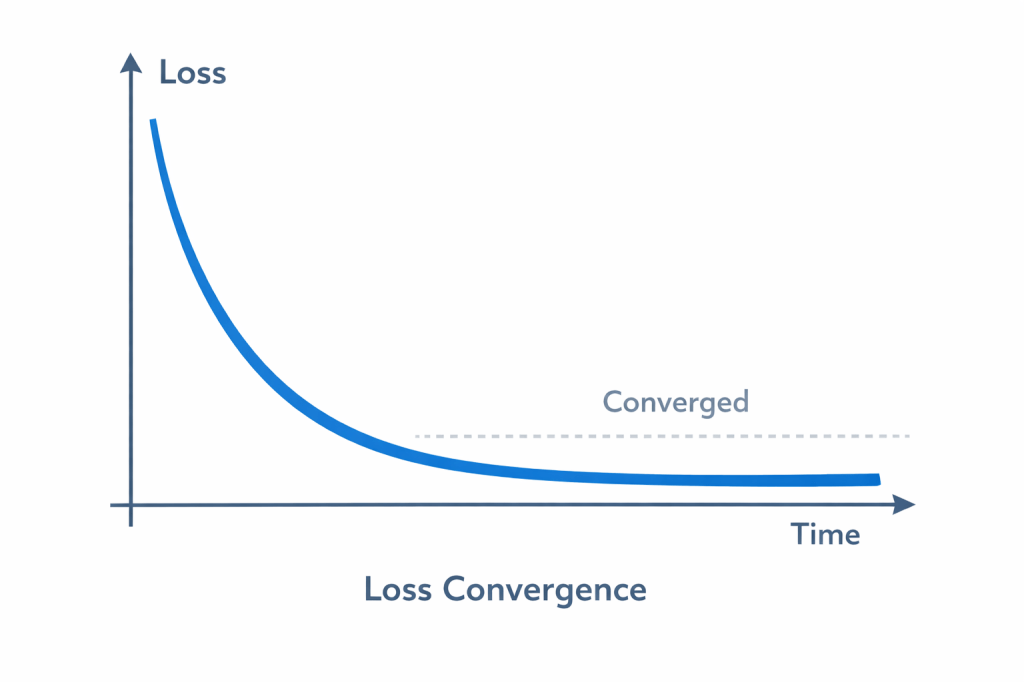

Ejemplo conceptual

- Inicio → pérdida alta

- Mitad → pérdida disminuye

- Final → pérdida se estabiliza

👉 Esto representa un proceso de convergencia exitoso

Factores que afectan la convergencia

Tasa de aprendizaje

- Muy alta → divergencia

- Muy baja → convergencia lenta

Tamaño de lote

- Lotes pequeños → más ruido

- Lotes grandes → más estabilidad

Optimización

- Algoritmos como Adam pueden acelerar la convergencia

Calidad de datos

- Datos ruidosos dificultan la convergencia

Insight clave

👉 Convergencia = estabilidad en el aprendizaje

Problemas comunes

Divergencia

- La pérdida aumenta

- El modelo no aprende

Convergencia prematura

- El modelo se estabiliza demasiado pronto

- Puede quedarse en un mínimo local

Sobreajuste

- El modelo converge en entrenamiento pero no generaliza

Relación con otros conceptos

La convergencia está estrechamente ligada a:

- Tasa de aprendizaje

- Tamaño de lote

- Descenso de gradiente

- Epoch vs iteración

Ejemplo en PyTorch

import torchimport torch.nn as nnimport torch.optim as optimmodel = nn.Linear(1, 1)optimizer = optim.SGD(model.parameters(), lr=0.01)losses = []for epoch in range(20): optimizer.zero_grad() loss = (model(torch.tensor([[1.0]])) - torch.tensor([[2.0]])).pow(2).mean() loss.backward() optimizer.step() losses.append(loss.item()) print(f"Epoch {epoch}, Loss: {loss.item()}")

👉 Observando la pérdida, puedes identificar si el modelo converge.

Impacto en el entrenamiento

Una buena convergencia implica:

- Entrenamiento eficiente

- Buen rendimiento

- Estabilidad

Conceptos relacionados

Conclusión

La convergencia es un objetivo central en el entrenamiento:

- Indica que el modelo ha aprendido patrones útiles

- Refleja estabilidad en el proceso

Sin convergencia, el modelo no puede considerarse entrenado correctamente.